在当今的数字化时代,大型网站已成为连接用户、服务和数据的超级枢纽。其背后支撑的海量数据处理能力,是保障网站高可用、高性能和高扩展性的基石。大型网站的架构设计,在很大程度上是围绕数据的高效处理、安全存储与智能应用展开的一场系统工程。

一、大型网站数据处理的核心挑战

大型网站的数据处理面临着前所未有的挑战:

- 数据规模巨大:每日产生PB级甚至EB级的用户行为、交易、日志等数据,传统的单机存储与计算模型完全失效。

- 高并发访问:数以亿计的用户同时在线,对数据库的读写请求呈爆发式增长,要求极低的响应延迟。

- 数据多样性:包括结构化数据(如用户信息)、半结构化数据(如JSON日志)和非结构化数据(如图片、视频),需要不同的处理技术。

- 高可用性与一致性要求:系统必须保证7x24小时不间断服务,同时在分布式环境下平衡数据的一致性、可用性和分区容错性(CAP定理)。

- 实时性需求:从用户点击到推荐反馈,从风险交易识别到监控告警,对实时数据处理(流处理)的能力要求越来越高。

二、核心架构技术与分层处理

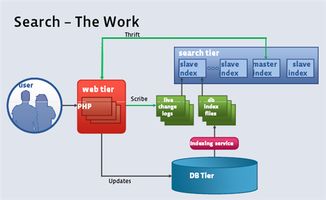

为应对上述挑战,现代大型网站通常采用分层的、分布式的数据处理架构:

1. 数据存储层:分而治之

- 读写分离与分库分表:将数据库拆分为主库(写)和多个从库(读),并进一步将大表按业务维度(如用户ID、时间)水平拆分,以分散压力。

- 多类型数据库并存(Polyglot Persistence):根据数据特性选用最佳存储。例如,关系型数据库(如MySQL、PostgreSQL)处理核心交易;NoSQL数据库(如Redis用于缓存、MongoDB用于文档存储、HBase用于海量明细);以及对象存储(如Amazon S3)存放静态文件。

2. 数据缓存层:加速访问

- 缓存无处不在:在应用层(本地缓存)、数据库前(分布式缓存如Redis、Memcached)、甚至CDN层面建立多级缓存,将热点数据的访问路径缩短,极大减轻后端存储压力。

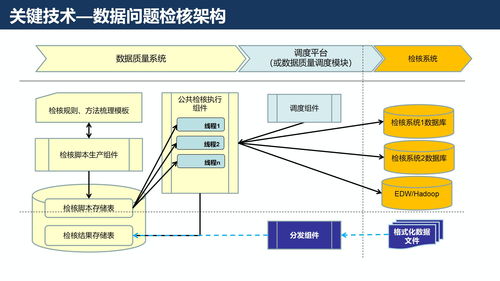

3. 数据处理与计算层:批量与流式并举

- 离线批量处理:针对海量历史数据的深度分析,采用以Hadoop HDFS、Spark为核心的大数据平台,进行ETL、数据挖掘和报表生成。

- 实时流处理:针对即时性要求高的场景,使用Flink、Storm、Spark Streaming等流计算框架,对数据流进行实时过滤、聚合与计算,支撑实时大屏、个性化推荐和风控。

4. 数据同步与集成层:连接孤岛

- 通过消息队列(如Kafka、RocketMQ)实现应用解耦和异步处理,同时它也是流处理的数据源。

- 使用数据同步工具(如Canal、Debezium)进行数据库的增量日志捕获与复制,实现异构数据源之间的实时同步。

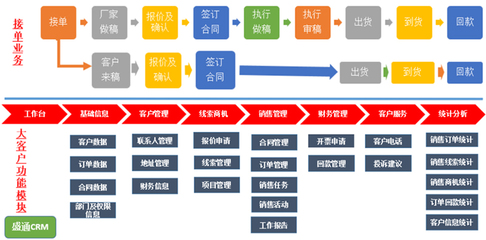

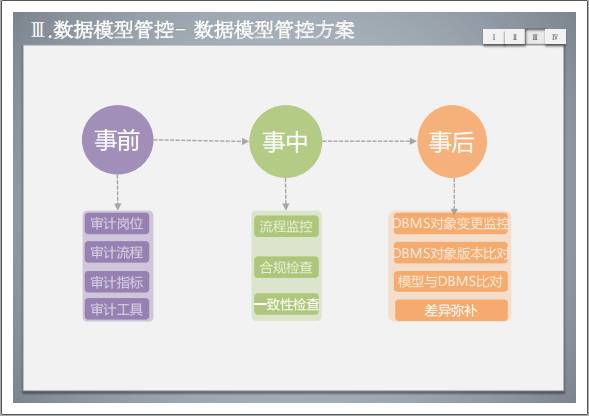

5. 数据服务与治理层:赋能业务

- 通过统一的数据API、数据中台或数据湖,将处理好的数据以服务形式提供给前端业务应用。

- 建立元数据管理、数据质量监控和数据血缘追踪体系,确保数据的可信、可靠与安全合规。

三、技术演进与未来趋势

大型网站的数据处理架构始终在快速演进:

- 从On-Premise到Cloud-Native:云原生技术(Kubernetes、Serverless)使得数据基础设施可以按需弹性伸缩,运维自动化程度更高。

- 从Lambda到Kappa架构:流处理能力的强化,使得更多场景可以用一套流处理系统同时处理实时和历史数据,架构更简洁。

- 从数据处理到数据智能:随着机器学习平台的集成,数据处理管道不仅用于存储和分析,更直接用于训练和部署AI模型,实现智能搜索、推荐和自动化决策。

- 实时数仓与数据湖仓一体化:打破离线与实时的壁垒,构建能同时支持实时查询与分析的统一数据平台(如Delta Lake、Apache Iceberg)。

###

大型网站的数据处理架构是一个复杂而精密的生态系统,其核心目标是在数据爆炸的时代,确保数据能够被高效、稳定、安全地转化为业务价值。它没有一成不变的银弹,而是在一致性、延迟、成本、复杂度之间不断权衡与迭代的艺术。随着硬件革新(如持久内存、DPU)和软件理念(如Data Mesh去中心化数据架构)的发展,这一领域将继续迎来深刻的变革,驱动网站向更智能、更敏捷的方向演进。